YAZI: JOHN PAVLUS

Yapay zekanın (AI) neler yapabileceğini görmek açısından son dönemi harika olarak değerlendirmek mümkün. Waymo, Arizona’da gerçek ödeme yapan müşterilere otonom taksi hizmeti sundu. OpenAI ve DeepMind’daki botlar, iki büyük e-spor müsabakasında üst düzey profesyonelleri yendi. Bir derin görüntüleme algoritması, akciğer tümörlerini teşhis etmede doktorlar kadar -ve bazen daha iyi- performans sergiledi.

Ancak yapay zekanın yapması gereken şeyler açısından durum çok parlak değil. Amazon’un yüz tanıma yazılımına bakalım: Teknoloji devinin algoritmalarının koyu tenli kadınların yüzlerini yaklaşık üçte bir oranda yanlış tanımladığını bildiren MIT araştırmacılarına göre ırkçıydı (açık tenli erkekler için ise neredeyse mükemmel performans gösterdi).

WeSee ve HireVue gibi şirketler tarafından risk değerlendirmesi yapma ve aday başvurularını tarama amacıyla kullanılan duygu tanıma algoritmalarına bakalım: Association for Psychological Science’a göre değersizdi. Birkaç sözcük öbeğinden yüzlerce kelimelik ikna edici metin yaratabilen ve GTP-2 adı verilen doğal dil işleme sisteminin art niyetle yanlış haber, düşmanca söylem ve hatta daha kötüsünü üretebileceği endişesiyle, kendi yaratıcısı OpenAI tarafından fazla riskli bulunmasıyla, bu alandaki titrek adımlar bile darbe aldı.

Başka bir deyişle 2019, yapay zeka adı verilen “inovasyon roketi” hakkında iki noktanın kaçınılmaz olarak netleştiği bir yıl oldu. Bir: Çoğumuzun beklediğinden daha hızlı ivme kazanıyor. İki: Bazı vidalar ciddi anlamda gevşek.

Güvenli bir mesafeden izlemek yerine bu rokete toplu olarak bindiğimiz göz önüne alındığında, bu ürkütücü bir gelişme. Ancak, yapay zekadaki kaygı uyandırıcı ilerlemenin iyi bir yönü var: Belki de ilk kez, yıkıcı bir teknolojinin istenmeyen sonuçları yıllar hatta on yıllar sonra değil, şu anda görülebiliyor. Ve bu, çok hızlı yol almaya yakınken, roketin yakıtını kısıp onu yönetebileceğimiz anlamına geliyor.

Bugün yapay zeka dediğimiz -yapay sinir ağları ile derin öğrenmeye dayalı- teknolojinin 2012’den önce tüm pratik amaçlar için mevcut olmadığını unutmak kolay. Model tanıma görevlerini öğrenmek için (kaba bir yaklaşımla, biyolojik beyin dokusuna benzer bir yaklaşımla organize edilmiş) dijital bağlantı katmanlarını kullanma konsepti onlarca yıl geriye gitse de büyük ölçüde akademik atmosferde sıkışmıştı. Daha sonra Eylül 2012’de, Toronto Üniversitesi profesörü ve gelecekteki “derin öğrenmenin vaftiz babası” Geoffrey Hinton’ın öğrencileri tarafından tasarlanan bir sinir ağı, ImageNet adlı son derece saygın bir bilgisayar-görüşü testinde beklenmedik rekorlar kırdı. Bu testte yazılımdan bir papağan ya da gitar gibi milyonlarca görüntünün içeriğini doğru şekilde tanımlaması istendi. Öğrencilerin sinir ağı, ikinci gelenin yarısı kadar hata yaptı.

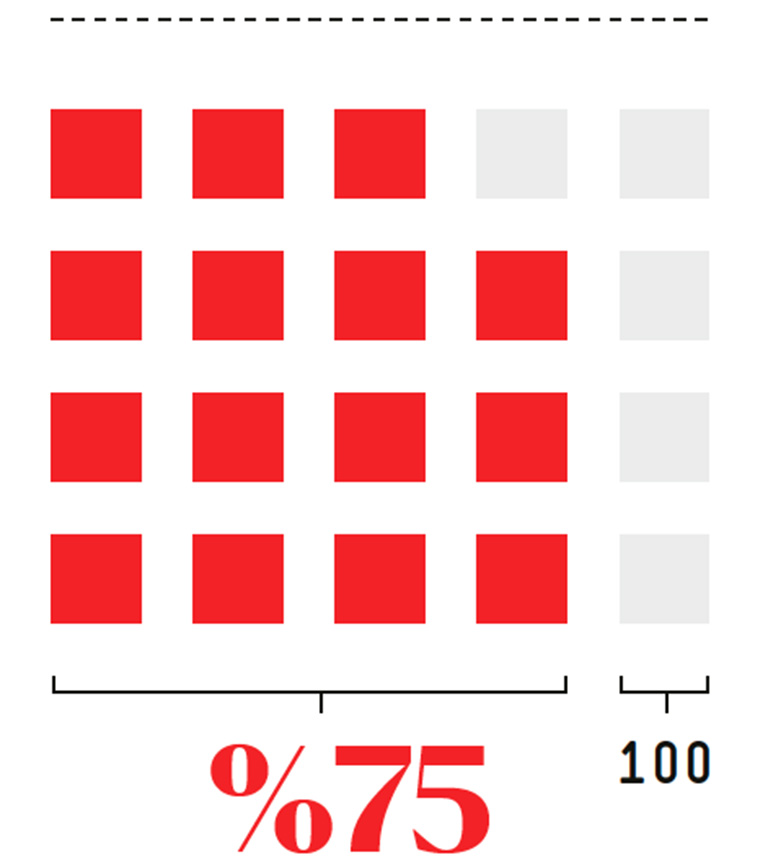

Aniden, derin öğrenme “işe yaradı”. Beş yıl içinde, Google ve Microsoft çok sayıda derin öğrenme uzmanını işe aldı ve kendini “yapay zekayı en ön sıraya koyan” şirket olarak tanımladı. Bu sadece büyük teknoloji şirketleriyle de sınırlı değildi: Danışmanlık firması McKinsey’nin 2018’de yaptığı küresel bir araştırmada, 2 bini aşkın şirketin dörtte üçünden fazlasının yapay zekayı işine entegre ettiği veya pilot programlar uyguladığı ortaya çıktı.

Andreessen Horowitz’ten analist Benedict Evans’ın ünlü deyişiyle, modern akıllı telefonların “dünyayı midesine indirmesi” 10 yıl sürdü; web’inki ise 20 yıl. Ancak yapay zeka -denetim firması PricewaterhouseCoopers’a göre 2017 ve 2018 yıllarında küresel GSYİH’ye tahminen 2 trilyon dolar katkıda bulunarak- sadece 5 yıl içinde laboratuvar ortamından ayrılıp ekonomik güce katıldı. Başkan Barack Obama’nın eski teknoloji danışmanı olan ve şu anda MIT’de yapay zeka politikaları araştırmalarını yöneten R. David Edelman, “Yapay zekanın evriminin hızı söz konusu olduğunda kesinlikle sıkıştırılmış bir zaman döngüsü üzerinde çalışıyoruz” diyor.

Bu benzeri görülmemiş hız, yapay zeka alanında hem ilerlemelerde hem de endişelerde etkili oldu. Küresel pazarlama danışmanı Edelman’ın Dünya Ekonomik Forumu işbirliğiyle 2019’da yaptığı bir araştırmaya göre, Amerikalıların yüzde 54 ila yüzde 75’i yapay zekanın fakirlere zarar vereceğini, zenginlere fayda sağlayacağını, sosyal izolasyonu artıracağını ve “insanların düşünsel yeteneklerinin kaybına” neden olacağını düşünüyor.

Ankete katılanların üçte biri, yapay zekanın (ünlülerin, hükûmet yetkililerinin ya da sıradan insanların derin öğrenme ağları tarafından yaratılan ikna edici sahte videoları aracılığıyla) önce bilgi savaşına, ardından da silahlı savaşa katkıda bulunabileceğini düşünüyor.

Öyleyse toplum, Edelman’ın (danışmanlık ile hiçbir ilişkisi olmadığını belirterek) “çağdaş Ludizm” dediği şeye başvurmadan nasıl tepki vermeli? Sonuçta, Sanayi Devrimi sırasında tezgahları kırmak, gerçek Ludistlerin işine yaramadı. Ancak, bunun ters tarafında yer alan -inovasyonun nihayetinde kendi karışıklıklarını çözeceğine dair körü körüne bir inanç- da bunu yapmayacaktır.

Roketle seyrederken gazı kesmek burada devreye giriyor. Teknolojik inovasyonun standart zaman çizelgesi “S eğrisi” olarak bilinen çizgiyi takip eder: Yavaş bir başlangıç, ardından artan bir eğim ve yaygınlaştığı noktada bitiş. Otomobil veya akıllı telefon gibi “dünyayı midesine indiren” önceki teknolojilerde, kasıtsız sonuçlar S eğrisinin yamacında, hatta platodayken, yani yükseklere çıkmadan önce açıklıkla görünür hale gelmemişti. Örneğin otomobillerin kitleselleşmesi, yavaş ortaya çıkan birkaç felakete yol açtı; sadece iklim değişikliği değil, aynı zamanda toplu taşımacılığın zayıflaması, onlarca yıla yayılan çarpık kent planlaması ve inanılmaz sayıda ölüm… Ve psikolog Jean Twenge 2017’de akıllı telefonların sosyal medya bağımlılığını ve kaygıyı teşvik ederek “bir nesli yok etmiş olabileceğini” iddia ettiğinde, yaklaşık 3 milyar insan bunları kullanıyordu. Her iki durumda da, bir şeylerin yanlış olduğunu fark etmeden önce beton zaten dökülmüştü. Ancak, yapay zeka yaklaşık beş yıl içinde “hiçbir yerden” “görünüşte her yere” giderek, aslında bize yolu düzeltmemiz için gerçek zamanlı bir geribildirim mekanizması sunuyor.

Sinir ağlarını daha yorumlanabilir ve daha az gizemli “kara kutular” gibi olacak şekilde tasarlayabilir miyiz? Derin öğrenme sistemlerini etik olmayan eğilimlere karşı sistematik olarak nasıl test ederiz? Yapay zeka uygulamalarını ve ürünlerini incelemek için FDA veya EPA muadili bir kurum oluşturulmalı mı? Max Planck İnsan Gelişimi Enstitüsü’nde yapay zekanın getirdiği sosyal zorlukları inceleyen bir bilim adamı olan Nick Obradovich, “Hızla değişmesi, bu soruların sorulmasına belirli bir aciliyet kazandırıyor” diyor.

Yapay zeka ile bu gerçek zamanlı hesaplaşma zaten devam ediyor. 2019 I/O konferansında Google, derin öğrenme ağları için bir tür “saçmalık dedektörü” görevi gören TCAV adlı bir sistemi tanıttı. (Kanser taraması yapan yapay zekanın istatistiksel hataları değil, tümörleri tespit ettiğinden emin olmak istemez misiniz? TCAV yardımcı olabilir!) Mayıs ayında aralarında ABD’nin de içinde bulunduğu 42 ülke, Ekonomik İşbirliği ve Kalkınma Örgütü (OECD) tarafından geliştirilen bir politika kılavuzu üzerinde anlaştı. Bu, “yapay zeka sistemlerinin sağlam, güvenli, adil ve güvenilir olacak şekilde tasarlanmasını amaçlayan uluslararası standartları desteklemeyi” içeriyor. Bu yılın başlarında, MIT araştırmacıları, algoritmaların ve insanların “vahşi doğada” nasıl etkileştiklerini araştırmak için tasarlanan, “makine davranışı” adı verilen yepyeni bir bilimsel disiplin oluşturdu. Bu çalışma, ekonomi, siyaset bilimi, robotik ve sosyoloji gibi çeşitli alanlardan iki düzine uzman tarafından ortaklaşa yürütüldü.

Bu çalışmanın yazarlarından Obradovich, “Gelecekte bir noktada hayatımızdaki algoritmaların geliştirilmesi ve kullanımı konusunda bazı düzenlemeler olacak” diyor ve ekliyor:

“Bu arada iyi eğitimli sosyal bilimcilerin devreye girerek, mevcut veya olası sorunları ortaya çıkarmak açısından rolü büyük.”

Yenilikçi teknolojiye dönük bu tutum bizi yapay zekayı sadece “çalıştırmaya” değil, aynı zamanda ona dönük bir davranış geliştirmeye teşvik edebilir. 5G internet, kripto paralar, otonom arabalar ve CRISPR gen düzenleme gibi diğer yeni yıkıcı teknolojilere verdiğimiz tepkileri de belirleyebilir. Edelman, “Bu sistemleri ve [sosyal] politikaları yeniden tasarlama ideali, yeni yenilikler için tekrarlanabilir bir formül olabilir ve aslında muhtemelen olmalı” diyor. Sonuçta, yapay zeka kendimizi bağlı bulacağımız son roket olmayacak. Ve kimsenin elinde bizim dışımızda pilotluk yapacak “doğru eleman” yok.

Kuantum Hızı

Yapay zeka, laboratuvardan hızla çıkarak ekonomik güce katıldı.

2 Trilyon Dolar

PricewaterhouseCoopers’ın hesaplamasına göre, yapay zekanın küresel GSYİH’ye 2017 ve 2018 yıllarındaki katkısı.

Danışmanlık firması McKinsey’nin 2018’de 2 bin şirket arasında yaptığı ankete göre, yapay zekayı işine entegre eden ya da bu amaçla pilot programlar uygulayanların oranı.

2019

Google bilgisayarlarının kuantum üstünlüğüne ulaştığı, yani normal süper bilgisayarların çözemediği sorunları çözebildiği yıl.